Hybrydowy RAG z segmentacją semantyczną

Skalowanie wyszukiwania hybrydowego RAG na 780 tysiącach stron

Piotr Chlebek · 2026-4-(praca w toku)

Piotr Chlebek · 2026-4-(praca w toku)

Streszczenie: in progress..

Słowa kluczowe: in progress..

(praca w toku)

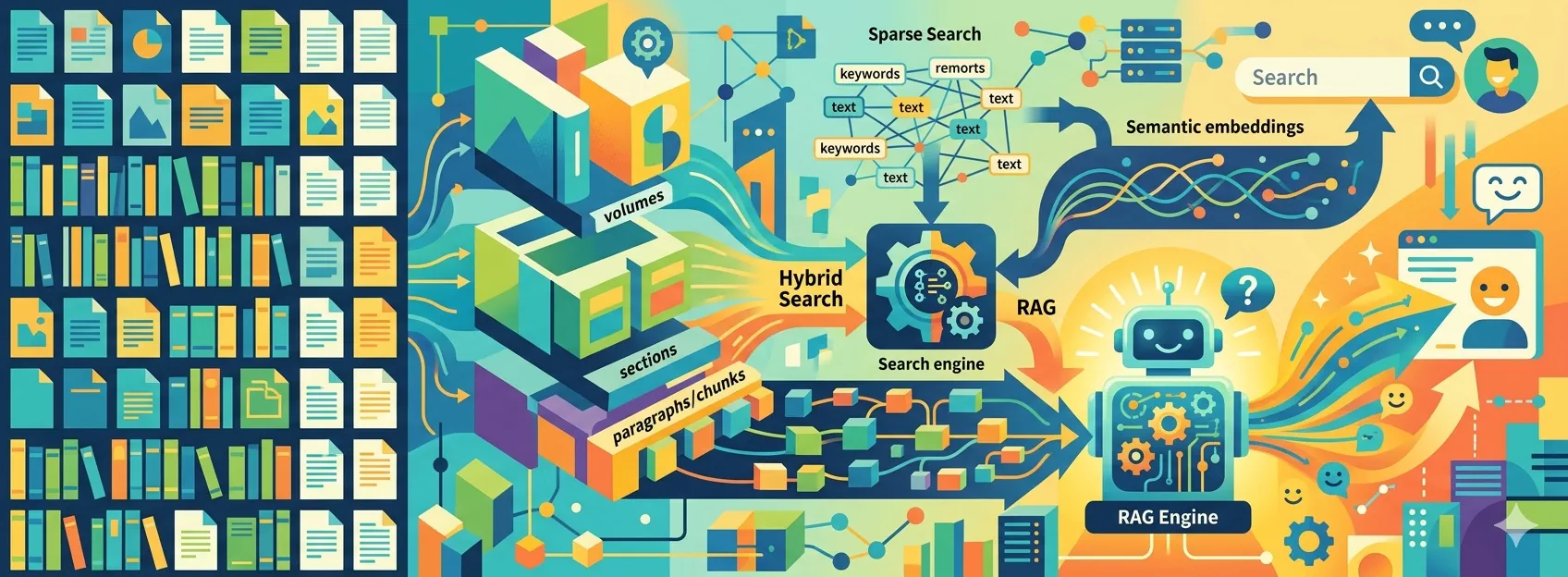

Architektura prywatnej, wertykalnej wyszukiwarki dla biblioteki 6000 dokumentów

Biblioteka, o której marzyłem: szybka, lokalna i pod pełną kontrolą

Ten projekt zrodził się z mojej miłości do literatury faktu oraz bogatych w wiedzę artykułów branżowych. Od dawna marzyłem o zbudowaniu systemu, który potrafiłby „zrozumieć” i przetworzyć moją dużą kolekcję dokumentów na tematy, które mnie interesują.

Ten tekst powstał z połączenia trzech impulsów. Po pierwsze, chciałem rozwinąć wątki, na które zabraknie czasu podczas mojej prezentacji: AI Tinkerers Gdańsk Meetup – 23 kwietnia. Po drugie, pisanie to dla mnie czysta frajda i najlepszy sposób na uporządkowanie myśli. Ale najważniejszym bodźcem byli moi koledzy z branży – to ich zachęty i ciekawość moich zmagań z nowymi technologiami sprawiły, że w końcu usiadłem do klawiatury. Skoro uznali, że te doświadczenia są warte opisania, nie mogłem ich zawieść.

Problem 5 milionów promptów

Po przetworzeniu około 6 tysięcy plików PDF otrzymałem 780 000 stron. Zdecydowałem się użyć kilku promptów do wyciągnięcia metadanych z każdej strony, co ostatecznie dało około 5 milionów zapytań do modelu LLM.

Przetworzenie 5 milionów promptów w chmurze nie jest tanie. Nawet z nowoczesnymi funkcjami, takimi jak buforowanie promptów (prompt caching) czy niższe ceny za przetwarzanie wsadowe (batching), koszty są wciąż zbyt wysokie. Aby zaoszczędzić, postanowiłem wykorzystać własny, lokalny sprzęt. Dodatkowym, ogromnym plusem jest to, że lokalne uruchamianie modeli zapewnia całkowitą prywatność moich danych. Szczegóły o tym, jak udało mi się to osiągnąć za pomocą vLLM, znajdziesz tutaj: Lokalne serwowanie LLM za pomocą vLLM.

Oczywiście wiążą się z tym pewne wyzwania. Lokalna sztuczna inteligencja zazwyczaj charakteryzuje się wyższymi opóźnieniami (wolniejszym czasem odpowiedzi) niż rozwiązania u dużych dostawców chmurowych. Z tego powodu muszę ostrożnie korzystać z LLM w zadaniach wymagających czasu rzeczywistego, takich jak reranking wyników wyszukiwania.

W tym poście:

- (praca w toku)

Powiązane wpisy:

- AI Tinkerers Gdańsk Meetup – 23 kwietnia

- W RAG nie chodzi o AI, lecz o inżynierię

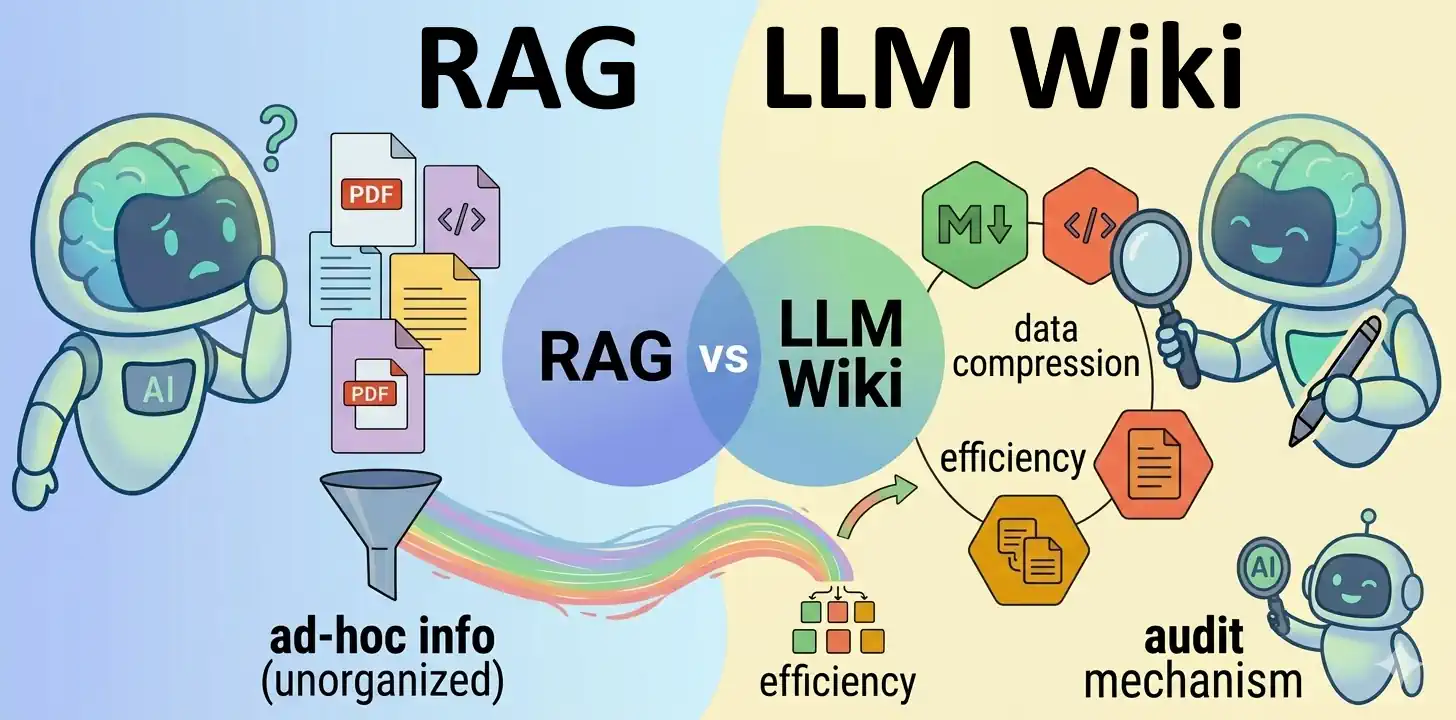

- LLM Wiki vs. Baza Wiedzy RAG

- Lokalne serwowanie LLM za pomocą vLLM

Odniesienia:

- [.] karpathy/llm-wiki.md - Andrej Karpathy

- [.] Seven Failure Points When Engineering a Retrieval Augmented Generation System - by Scott Barnett, Stefanus Kurniawan, Srikanth Thudumu, Zach Brannelly, Mohamed Abdelrazek

- [.] RAG Isn’t a Modeling Problem. It’s a Data Engineering Problem - by Alex Merced

- [.] Towards Requirements Engineering for RAG Systems - by Tor Sporsem, Rasmus Ulfsnes

- [.] "RAG is Dead, Context Engineering is King" — with Jeff Huber of Chroma - ~1h interview with Jeff Huber

- [.] 10 RAG Failure Modes at Scale (and How to Fix Them) - by Bhagya Rana

- [.] -

Źródło obrazów: Google DALL-E 3 (04.2026).