Bei RAG geht es nicht um KI, sondern um Engineering

Hör auf, an die LLM-Magie zu glauben – es ist Zeit für echte Datentechnik und die 20 Module, die dein Tutorial vergessen hat

Piotr Chlebek · 2026-4-(In Bearbeitung)

Piotr Chlebek · 2026-4-(In Bearbeitung)

Zusammenfassung: This article critiques the oversimplified "happy path" of RAG tutorials, arguing that while a basic prototype takes minutes, a production-grade system requires months of rigorous engineering. The author moves beyond the naive "slice and search" approach to address the "hundred-headed monster" of real-world data and security, framing RAG not as AI magic, but as a complex, multi-layered infrastructure challenge that demands a professional, senior-level commitment to architectural depth.

Schlüsselwörter: RAG engineering, Retrieval-Augmented Generation production, AI architecture, enterprise RAG, RAG implementation, LLM production deployment, semantic chunking, RAG data pipeline, vector database, RAG security, AI infrastructure, production-grade AI, RAG challenges, RAG modules.

(In Bearbeitung)

RAG ist eine technische Herausforderung

Beim Durchstöbern der AI & Machine Learning Community Gruppe bin

ich auf einen  Beitrag [1] und eine Präsentation

von

Beitrag [1] und eine Präsentation

von  Hastika Cheddy gestoßen, der den Nagel auf den Kopf traf.

Ihre These zu KI-Implementierungen war brutal ehrlich:

Hastika Cheddy gestoßen, der den Nagel auf den Kopf traf.

Ihre These zu KI-Implementierungen war brutal ehrlich:

„Ich habe über 10 RAG-Implementierungen in Unternehmen geprüft. Jede einzelne ist im Produktivbetrieb gescheitert. Nicht wegen des LLMs. Nicht wegen des Embedding-Modells. Sondern wegen einer fehlerhaften Architektur“.

Diese Worte haben sofort bei mir resonniert. Da das Fundament öfter versagt als die Modelle selbst, ist es an der Zeit, dass ich meinen Senf dazu gebe, wie man effektive RAG-Systeme aufbaut.

RAG: 5 Minuten im Tutorial, 5 Monate in der Produktion

Analysiert man die allgemein verfügbaren Beispiele für RAG-Systeme, drängt sich der Eindruck auf, dass wir in einer Phase naiver und zu hastiger Implementierungen feststecken. Diese Technologie verspricht zwar das Blaue vom Himmel, ist aber in Wirklichkeit extrem anspruchsvoll und launisch. Die Versuchung, schnell eine einfache Sequenz abzufeuern – „Text in Stücke schneiden, in die Vektordatenbank werfen, suchen“ – ist so groß, dass entscheidende ingenieurtechnische Grundlagen oft in den Hintergrund rücken.

Aspekte wie verlässliche Datenqualität, Auditierbarkeit des Prozesses oder Angriffsresistenz erhalten eine gefährlich niedrige Priorität. Erschwerend kommt hinzu, dass fundamentale Designentscheidungen im Vorbeigehen getroffen werden. Ein Beispiel ist der massenhafte Einsatz von festem Chunking (fixed-size chunking), das im Vergleich zu realen Geschäftsdokumenten fast immer gegen raffiniertere, semantische Segmentierungstechniken verliert.

Natürlich gibt es fortgeschrittenere RAG-Systeme, die über solide architektonische Grundlagen verfügen und in Produktionsumgebungen recht effizient arbeiten. Diese werden jedoch in Tutorials kaum besprochen – vielleicht, weil sie für Menschen, die nach schnellen Erfolgen dürsten, nicht so attraktiv erscheinen. Sie werden nämlich mit dem langwierigen und akribischen Aufbau eines komplexen, mehrschichtigen Systems assoziiert.

Meiner Meinung nach ist genau diese Komplexität der Kern des Ganzen und das Interessanteste daran. Deshalb ermutige ich dich, Leser, RAG als eine ingenieurtechnische Herausforderung zu betrachten. Hier suchen wir nicht nach den „tief hängenden Früchten“, sondern gehen das Thema mit Senior-Ernsthaftigkeit an – so, wie man an den Entwurf jedes kritischen und komplexen Systems herangeht.

Von drei Kacheln im Diagramm zum hundertköpfigen Monster

Die meisten Schemata, auf die wir im Netz stoßen, stellen RAG als einen eleganten und fast wartungsfreien Mechanismus dar. Das Bild ist verlockend: Ein Dokument gelangt in die Maschine, verwandelt sich in Vektoren, durchläuft „drei Blöcke insgesamt“ und generiert die ideale Antwort. Leider hält diese Vision des „Happy Path“ der ersten Kollision mit der Realität selten stand.

Stellen, an denen diese schematischen Vereinfachungen die tatsächliche Komplexität des Prozesses maskieren, gibt es zur Genüge:

(TBD: Hier folgt die Liste der Beispiele)

In der realen Welt sind deine Daten keine steril sauberen Textdateien, sondern „schmutzige“ PDFs mit mehrstöckigen Tabellen, Fußzeilen und unoffensichtlichen Strukturen. Hinzu kommen Nutzer, die Fragen selten auf vorhersehbare und geordnete Weise stellen. Damit das System aufhört zu halluzinieren und anfängt, Probleme real zu lösen, müssen wir die Illusion der Einfachheit zugunsten einer soliden Ingenieursarbeit aufgeben, die den Prozess auf jeder Stufe absichert.

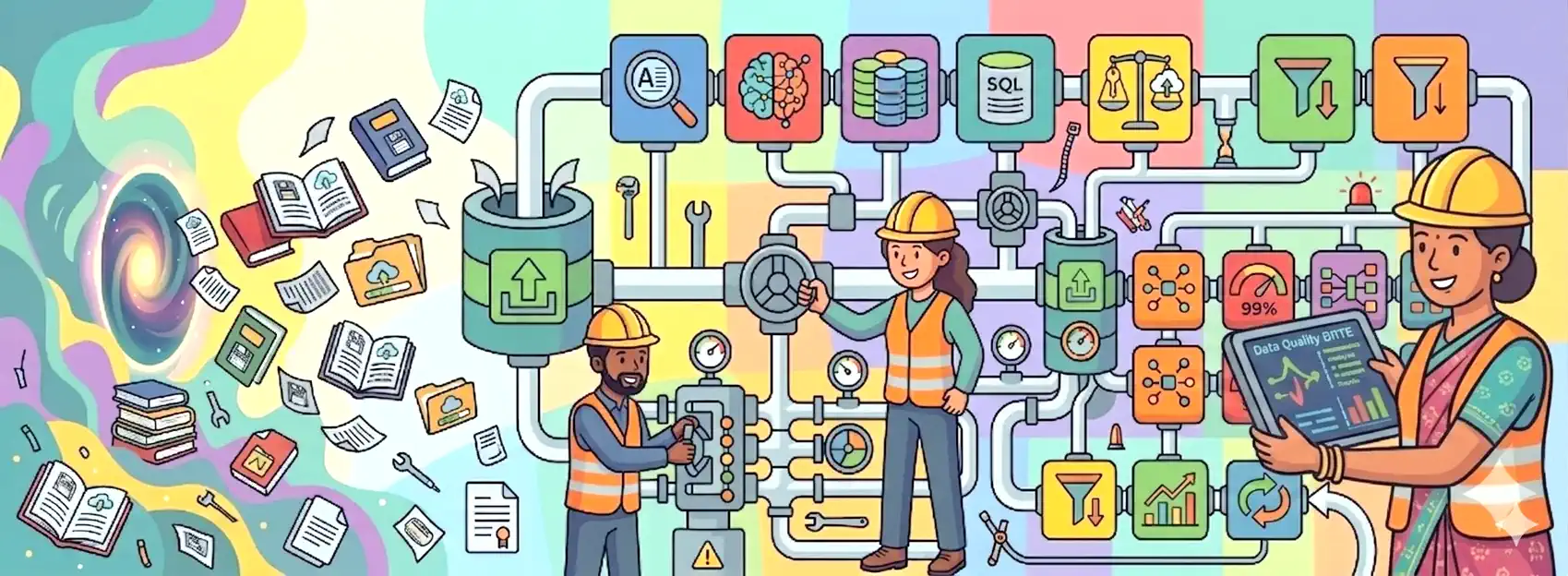

Warum ein Produktionssystem 15+ Module benötigt und nicht nur drei?

Die wahre Anatomie eines professionellen RAG-Systems reduziert sich nicht nur auf die drei einfachen Schritte, die das Akronym selbst suggeriert: Abrufen (Retrieve), Erweitern (Augment) und Generieren (Generate). Das ist nur die Spitze des Eisbergs. Wenn du eine Lösung baust, die resistent gegen ungeordnete Daten, desorientierte Nutzer und sogar böswillige Manipulationsversuche sein soll, musst du viel tiefer blicken.

Unten findest du eine Liste von 20 Komponenten, die in Betracht gezogen werden sollten – und unter Geschäftsbedingungen meist einfach implementiert werden müssen –, damit RAG nicht mehr nur eine technische Kuriosität ist, sondern zu einem zuverlässigen Werkzeug der Enterprise-Klasse wird.

Erst eine Architektur, die diese Aspekte berücksichtigt, ermöglicht es, ein System zu schaffen, das für Krisensituationen, Audits oder potenzielle Rechtsstreitigkeiten bereit ist. Man sollte sich ein Prinzip merken: Bei RAG ist der größte technische Aufwand keineswegs mit der Wahl des Sprachmodells selbst verbunden, sondern mit dem Bau der „Rohre“, durch die die Daten fließen. Genau in dieser auf den ersten Blick unsichtbaren Infrastruktur entscheidet sich, ob dein System eine echte Unterstützung oder ein spektakulärer Implementierungsfehlschlag wird.

RAG ist kein fertiges Schachtelprodukt, sondern ein kontinuierlicher Prozess. Der Erfolg hängt nicht vom Kauf eines Abonnements für die teuersten LLMs ab, sondern von der mühsamen Arbeit an der Qualität und dem Informationsfluss. Die kognitive Dissonanz wird erst verschwinden, wenn wir aufhören, KI wie Magie zu behandeln, und anfangen, in ihr ein weiteres, komplexes Element moderner Softwarearchitektur zu sehen.

...work in progress...

In diesem Beitrag:

- (In Bearbeitung)

Ähnliche Beiträge:

- AI Tinkerers Gdańsk Meetup – 23. April

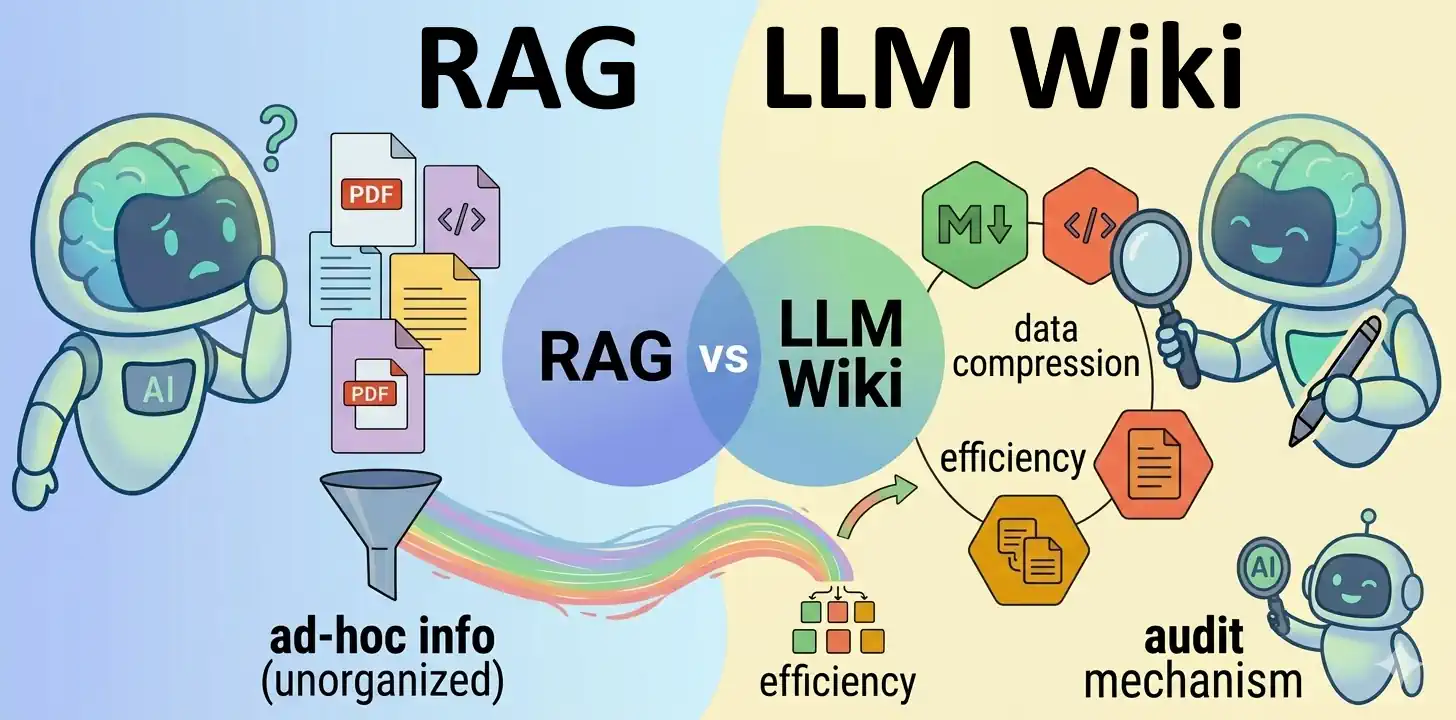

- LLM-Wiki vs. RAG-Wissensdatenbank

- Lokales Serving des LLM mit vLLM

- Hybrider RAG mit semantischem Chunking

Referenzen:

- [1]

RAG isn’t an AI problem. It’s an engineering problem - Hastika Cheddy

RAG isn’t an AI problem. It’s an engineering problem - Hastika Cheddy - [.] karpathy/llm-wiki.md - Andrej Karpathy

- [.] How to Build a Document Processing Pipeline for RAG with Nemotron - Chia-Chih Chen, Moon Chung, Nave Algarici and Sean Sodha

- [.] -

Bildquelle: Google DALL-E 3 (04.2026).

Schlüsselkomponenten einer zuverlässigen RAG-Architektur

Data Ingestion Layer (Datenaufbereitung)

Dies umfasst alles, was passiert, bevor ein Benutzer überhaupt eine Frage stellt. Hier wird das Wissen „bereinigt und geordnet“.

| Komponente | Funktionsweise | Warum es wichtig ist |

|---|---|---|

| ETL: Datenqualität und -integrität (Bereinigung, Deduplizierung, Normalisierung) | Datenselektion und „Aufräumen“: Entfernen von Rauschen, Beheben von Scanfehlern (OCR), Löschen von Duplikaten und Vereinheitlichen von Formaten. | Verhindert das GIGO-Prinzip (Garbage In, Garbage Out). Saubere Daten verringern das Risiko von Halluzinationen und fehlerhaften Modellantworten. |

| ETL: Fortgeschrittenes Parsing und Chunking | Zerlegt Dokumente in logische Fragmente (Chunks) unter Berücksichtigung der Struktur (Tabellen, Überschriften, Metadaten). | Ermöglicht es dem System, spezifische Informationen präzise aus der Datenbank zu extrahieren und dabei den Kontext zu wahren, was für treffsichere LLM-Antworten unerlässlich ist. |

| Inkrementelle Aktualisierungen (Incremental Updates) | Automatische Aktualisierung der Vektordatenbank mit neuen oder geänderten Daten, ohne alles neu indexieren zu müssen. | Garantiert den Zugriff auf aktuelle Informationen (z. B. Preise oder Vorschriften) und senkt die Systemwartungskosten drastisch. |

Query Orchestration Layer (Abfrage-Orchestrierung)

Dies ist der Moment, in dem das System analysiert, was der Mensch eigentlich fragt.

| Komponente | Funktionsweise | Warum es wichtig ist |

|---|---|---|

| Intelligente Steuerung (Query Routing) | Das System entscheidet, in welcher Datenbank, welchem Modell oder welcher API nachgesehen werden soll (z. B. ob technische Dokumentationen oder HR-Verfahren abgefragt werden). | Nicht jede Frage erfordert das Durchsuchen des gesamten Unternehmenswissens. Der Router spart Zeit und erhöht die Präzision, indem er die Anfrage in den richtigen Daten-„Korb“ leitet. |

| Anfragetransformation (Umschreiben und Erweitern) | Schreibt die Benutzeranfrage in ein Format um, das für die Suchmaschine besser verständlich ist. Dekomposition für mehrere Anfragen. Hypothetical Document Embeddings (HyDE). | Benutzer schreiben oft unpräzise. Wenn jemand fragt „Und wie viel kostet das?“, muss das System wissen, nach welchem Produkt zwei Sätze zuvor gefragt wurde. |

| Gedächtnisverwaltung (Memory Management) | Speichern und intelligentes Zusammenfassen vorangegangener Gesprächsteile. | Wenn ein Benutzer 10 Fragen hintereinander stellt, würde das Senden des gesamten Verlaufs an das Modell sehr viel Platz (Token) verbrauchen. Man benötigt ein Modul, das sich nur an die wichtigsten Threads „erinnert“. |

| Metadatenverwaltung und Filterung (Self-Querying) | Ermöglicht hartes Filtern der Ergebnisse nach Datum, Abteilung oder Dokumenttyp vor der semantischen Suche. | Wenn ein Kunde nach „Berichten aus 2024“ fragt, soll das Modell ihm keine Daten von 2019 vorschlagen, nur weil sie „semantisch ähnlich“ sind. |

Retrieval & Ranking Layer (Suche & Bewertung)

Das Herzstück von RAG ist die Suche nach der Nadel im Heuhaufen. Diese Gruppe ist für die Qualität der gefundenen Dokumente verantwortlich.

| Komponente | Funktionsweise | Warum es wichtig ist |

|---|---|---|

| Hybride Suche (Hybrid Search) | Kombiniert Vektorsuche (semantisch), Stichwortsuche (BM25) und Graphsuche (beziehungsbasiert). Teilweise unter Einbeziehung von multimodaler Suche. | Vektoren erfassen die Absicht gut, haben aber Schwierigkeiten z. B. mit spezifischen Identifikatoren wie Seriennummern. Die Ergänzung durch die Graphsuche ermöglicht es dem System, Entitätsbeziehungen und Hierarchien zu durchlaufen und so tiefen Kontext aufzudecken, den die Vektor- oder Stichwortnähe übersehen könnte. |

| Re-ranking (Relevanz-Neubewertung) | Berechnet die Relevanz der Top-Ergebnisse der Suchmaschine mithilfe eines präziseren Modells neu. | Die Vektorsuche ist schnell, aber oft „verrauscht“. Der Re-ranker stellt sicher, dass die tatsächlich relevantesten Abschnitte ganz oben landen. |

| Deduplizierung und Ergebnisselektion (Post-processing) | Aussortieren redundanter, fast identischer Fragmente zugunsten einzigartiger Inhalte (z. B. mittels MMR-Algorithmus). | Stellt die Informationsvielfalt im Kontextfenster sicher. Anstatt dasselbe zu wiederholen, erhält das Modell ein breiteres Datenspektrum, was die Antwortqualität erhöht. |

Generation & Trust Layer (Generierung & Vertrauen)

Hier erstellt das LLM die Antwort, während das System dafür sorgt, dass diese sicher und wahrheitsgetreu ist.

| Komponente | Funktionsweise | Warum es wichtig ist |

|---|---|---|

| Prompt Engineering und Kontext-Kompression | Optimiert die Art und Weise, wie Daten an das LLM übergeben werden, indem nur die relevantesten Fragmente ausgewählt werden, um das Kontextfenster nie zu überschreiten und Token zu sparen. | Das Hinzufügen von zu viel Text (das „Lost in the Middle“-Phänomen) führt dazu, dass sich das Modell verliert und wichtige Fakten ignoriert. |

| Schutzmechanismen (Guardrails) – Sicherheit und Glaubwürdigkeit | Fungiert als intelligenter Filter für Fragen und Antworten. Blockiert Beleidigungen, Phishing-Versuche und prüft, ob die Antwort tatsächlich auf Ihren Dokumenten basiert (Grounding). | Schützt vor Imageverlust und Halluzinationen. Sorgt dafür, dass der Bot keine Betriebsgeheimnisse verrät, nicht vulgär wird und keine Fakten erfindet, die nicht in der Datenbank stehen. |

| Zitate und Quellenangaben (Citations & Attribution) | Das Modell muss die konkrete Quelle angeben (z. B. Link zur PDF-Datei oder Seitenzahl), aus der es die Information bezogen hat. | Dies ist das absolute Fundament für Vertrauen. Der Nutzer muss schnell prüfen können, ob das Modell flunkert. Ohne Quellenlinks verliert RAG seinen größten Vorteil. |

| Bewertung der Antwortsicherheit (Confidence / Uncertainty) | Einschätzung, wie sehr das System der Antwort „vertraut“. | Ermöglicht es, dem Nutzer den Grad der Gewissheit anzuzeigen und zu entscheiden, ob die Antwort überhaupt ausgegeben werden soll. |

| Fallback-Szenarien und Fehlerbehandlung | Behandelt Situationen wie: keine Ergebnisse, niedrige Sicherheit, Timeouts. | Ein System ohne Fallbacks wird früher oder später Unsinn antworten, anstatt zu sagen: „Ich weiß es nicht.“ |

Operations & Governance Layer (Betrieb & Verwaltung)

Das ist es, was das System kostengünstig und schnell macht und uns verstehen lässt, warum es manchmal nicht funktioniert.

| Komponente | Funktionsweise | Warum es wichtig ist |

|---|---|---|

| Zugriffskontrolle (Berechtigungen und ACLs) | Stellt sicher, dass der Benutzer nur das sieht, wozu er berechtigt ist. | Ohne dies könnte RAG HR-Daten, Finanzberichte oder vertrauliche Dokumente offenlegen. |

| Cache-Ebene (Semantischer Cache) | Speichert Antworten auf ähnliche Fragen und gibt diese zurück, ohne das LLM erneut abzufragen. | Skalierung ist teuer. Caching reduziert Latenzzeiten und API-Kosten um bis zu 30-50 %. |

| Evaluationsmodul (RAGAS/TruLens) | Automatisierte Tests zur Messung von Treue (Faithfulness) und Kontextrelevanz (Relevancy). | Ohne Metriken weiß man nicht, ob die Änderung eines Modells oder der Chunk-Größe das System tatsächlich verbessert oder verschlechtert. Ein „Vibe Check“ ist keine Strategie. |

| Observability & Tracing (Beobachtbarkeit & Verfolgung) | Vollständiges Protokoll jedes Schritts + Metriken: Was wurde gesucht, was landete im Prompt, wie hat das Modell geantwortet. | Wenn ein Benutzer einen Fehler meldet, müssen Sie genau sehen können, in welchem Modul der Fehler aufgetreten ist: Versagte die Suche oder versagte das LLM? |

| Feedback-Schleife (Human-in-the-loop) | Unterstützt das Sammeln von Feedback von Benutzern, um das System zu verbessern. | Selbst die beste Evaluierung kann die Meinung eines echten Menschen nicht ersetzen. Diese Daten ermöglichen es Ihnen später, das System nachzubessern oder fehlerhafte Fragmente in der Wissensdatenbank zu korrigieren. |